Buenas, esto es BIMPRAXIS, el podcast donde el

BIM se encuentra con la inteligencia artificial.

Exploramos la ciencia, la tecnología y el futuro

desde el enfoque de la arquitectura, ingeniería y

construcción.

¡Empezamos!

Buenas, estamos ya en el episodio 45 y

seguimos con la serie Herramientas Open Source Gratuitas,

relacionadas, claro, con la IA.

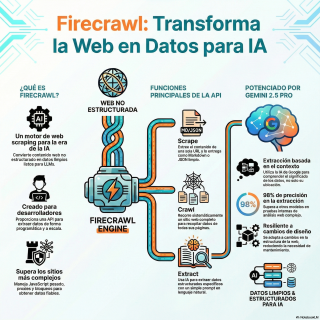

Hoy traemos una que se llama FireCrowl y

ahora os explicamos qué es esto.

Bienvenidos al podcast de BIMPRAXIS.

Vamos a empezar, como siempre, por el principio.

Cualquiera que esté metido en construir aplicaciones de

inteligencia artificial sabe que todo, absolutamente todo, se

basa en los datos.

Son el combustible, sí.

Exacto.

Pero claro, conseguir esos datos en la web

suele ser el primero y el mayor obstáculo.

Uf, y tanto.

Hay que extraerlos, luego limpiarlos, ponerlos en un

formato que un...

una IA pueda entender.

Es un trabajo enorme.

Y ahí es donde entran herramientas como la

de hoy.

Justo ahí.

Ahí es donde entra FireCrowl.

En esencia, es una API, una interfaz de

programación, que está pensada para desarrolladores.

Su misión es muy clara.

Convertir cualquier sitio web en datos limpios y

listos para un modelo de lenguaje grande, un

LLM.

O sea, que no es la típica herramienta

visual de apuntar y hacer clic.

Para nada.

Un motor.

Uno muy potente.

Para sacar información de la web de forma

programada.

Vale, vamos a desgranar esto un poco.

La idea principal, entonces, es que se encarga

de las partes más frustrantes de lo que

llamamos web scraping, ¿no?

Eso es.

Por ejemplo, lidiar con esas webs modernas que

están llenas de JavaScript y cargan el contenido

poco a poco.

Que son un dolor de cabeza.

Totalmente.

O gestionar los proxys para que no te

bloqueen el acceso a la primera de cambio.

Se encarga de toda esa fontanería.

De hecho, se centra en cuatro funciones principales.

A ver.

La primera sería scrape, que es raspar.

Le das una única página web y te

saca el contenido.

¿Y cómo te lo devuelve?

Pues te lo da como un archivo Markdown

ya limpio o en formato JSON, ya estructurado.

Vale.

Luego está crawl, que es rastrear.

Esto ya es para recorrer un sitio web

entero, todas sus páginas, y recopilar los datos

del dominio completo.

Entendido.

La tercera es map, mapear.

Te da un mapa rápido de todas las

URLs de un sitio, para tener una visión

general de la estructura.

¿Y la última?

La última es extract.

Y esta es la más avanzada, porque está

impulsada por IA.

Saca datos muy específicos y estructurados de una

página.

Has mencionado lo del Markdown limpio y me

parece un detalle interesante.

Porque puede parecer algo menor, pero es bastante

importante, ¿verdad?

Es fundamental.

Reduce drásticamente la cantidad de tokens que envías

al modelo de IA.

Claro.

¿Y eso se traduce directamente?

En un ahorro de costes, en las llamadas

a la API.

Y, muchas veces, también en un mejor rendimiento

del modelo, porque le das la información mucho

más clara.

Aquí es donde la cosa se pone realmente

interesante.

En esa función extract.

¿Totalmente?

La extracción de datos de toda la vida

se basaba en apuntar a elementos muy concretos

del diseño de una web, ¿no?

Exacto.

Y si un desarrollador cambiaba algo, por mínimo

que fuera… Adiós a Scraper.

Se rompía.

Era increíblemente frágil.

Una pesadilla de mantener.

Y la función extract de Firecrawl soluciona eso.

¿Cómo?

Pues lo soluciona cambiando el enfoque.

En lugar de reglas fijas, usa inteligencia artificial.

El desarrollador le da una URL y una

instrucción en lenguaje natural.

Algo como, obtén los nombres, cargos y correos

del equipo directivo.

Ah, vale.

Le hablas como una persona.

Justo.

Y, además, defines la estructura JSON en la

que quieres recibir esos datos.

Y la IA de Firecrawl analiza la persona.

Entiende lo que le pides, encuentra la información

y te la da ya estructurada.

La ventaja principal, entonces, es la resiliencia.

Esa es la palabra.

Como entiende el significado de los datos, se

puede adaptar a los cambios de diseño sin

tener que reescribir el código.

Y sabemos qué tecnología hay detrás de esto,

¿verdad?

¿Qué motor usa?

Sí, sí, que lo sabemos.

Usan Gemini 2 .5 Pro, de Google, para

potenciar este motor de extracción.

Vaya.

De hecho, el cofundador de Firecrawl, Eric Ciarla,

dijo que este modelo fue lo que… Hizo

factible todo el proyecto.

¿Ah, sí?

Sí.

Parece que otros modelos no manejaban bien la

complejidad del contenido web real.

¿Y qué tal la precisión?

Pues en sus pruebas internas dicen que Gemini

2 .5 Pro alcanzó una precisión del 98%.

Un 98 % es una cifra altísima.

Sí.

Puede ser un poco confuso.

No hay un único modelo, sino dos.

¿Dos sistemas diferentes?

Exacto.

Y hay que entender los dos para calcular

los costes reales.

Por un lado, está el modelo de credibilidad.

Este se aplica a las funciones básicas de

scrape y crawl.

El más predecible, imagino.

Sí.

Una llamada a la API o una página

rastreada suele costar un crédito.

Los planes van desde uno gratuito con 500

créditos, que se dan una sola vez, hasta

planes de pago como el hobby, por 19

dólares, que te da 3 .000 créditos al

mes.

Vale.

Hasta ahí bien.

¿Y el segundo modelo?

Pues aquí está el detalle crucial.

La función de extracción con IA, la de

extract, no utiliza el sistema de créditos.

Ah.

Se factura aparte, basándose en tokens, muy parecido

a cómo pagas por las APIs de OpenAI

o Anthropic.

O sea que es una suscripción completamente separada.

Completamente.

Si alguien contrata, no sé, el plan estándar

para raspar datos, pensando que lo tiene todo…

Se va a llevar una sorpresa.

Necesita comprar un plan adicional solo para la

función de extracción.

Es un detalle que es fácil pasar por

alto, la verdad, y que puede generar costes

inesperados.

Desde luego.

Los planes para extract empiezan en 89 dólares

al mes, por 18 millones de tokens al

año, y de ahí para arriba.

Entonces, ¿qué significa todo esto?

Que la suscripción a Firecrawl es en realidad

solo el punto de partida.

Correcto.

Al construir una solución de IA personalizada, hay

otros costes, y son significativos.

Como por ejemplo… El tiempo de ingeniería.

Suele ser el mayor gasto.

Necesitas desarrolladores cualificados para construir la aplicación, probarla,

mantenerla.

Claro.

Las horas de desarrollo.

Luego, los costes del LLM.

Firecrawl te da los datos, pero todavía tienes

que pagar a un proveedor como OpenAI o

Anthropic para que los procesen.

Y la infraestructura, donde corre todo.

Por supuesto.

Los costes de infraestructura.

Necesitas un sitio donde alojar la aplicación, bases

de datos vectoriales como Pinecone, etc.

Y también he leído que puede haber problemas

de escalabilidad.

Sí, algunos usuarios han señalado que en rastreos

a gran escala es muy fácil agotar los

créditos.

Y eso te puede llevar a tarifas por

exceso de uso que disparan la factura.

En resumen, Firecrawl te da las materias primas,

y de excelente calidad por lo que parece.

Sí.

Pero la empresa todavía tiene que construir la

fábrica, desplegarla y mantenerla para usar esos datos.

Esa es la disyuntiva.

Exactamente.

Las fuentes lo comparan con un enfoque de

plataforma todo en uno.

Es la diferencia entre comprar las piezas para

montar el coche… O comprar el coche ya

fabricado.

Justo.

Son dos filosofías distintas.

Una es para quien quiere construir algo a

medida, desde cero, y la otra es para

quien busca resolver un problema de negocio concreto

de forma rápida.

Vale.

Entonces, para dejarlo claro, ¿quién es el usuario

ideal de esta herramienta?

Es ideal para equipos técnicos que están construyendo

aplicaciones de IA personalizadas desde cero.

¿Desarrolladores?

¿Ingenieros?

Sí.

De hecho, se integra con herramientas que ya

usan, como Landchain, donde funciona como un cargador

de documentos.

Sí.

De hecho, se integra con herramientas que ya

usan, como Landchain, donde funciona como un cargador

de documentos.

Además, al ser de código abierto, pues el

código es transparente y la comunidad puede contribuir.

O incluso puedes autoalojar la herramienta en tus

propios servidores.

Que eso para muchas empresas es clave.

Fundamental.

¿Y para qué se está usando en el

mundo real?

¿Qué casos de uso destacan?

Pues… son bastante variados.

Uno muy claro es crear asistentes de IA

más inteligentes.

Alimentar chatbots con contenido web que sea preciso

y en tiempo real.

Vale.

Otro es el enriquecimiento de leads.

Mejorar los datos de ventas con información extraída

de la web sobre posibles clientes.

Eso es muy potente para un equipo comercial.

Muchísimo.

Y también para la investigación profunda.

Para extraer información exhaustiva para análisis de mercado

o para temas académicos.

Y no hay que olvidar que, por debajo,

gestiona automáticamente tareas complejas, como el manejo de

proxies, contenido bloqueado por Javascript, e incluso puede

analizar archivos PDF y 12x que encuentre en

la web.

Entonces, como conclusión, Firecrawl es una herramienta que,

además de ser una herramienta potente y muy

bien diseñada, pero para una tarea muy, muy

específica.

Sí, convertir la web en datos estructurados para

los modelos de IA.

Si se cuenta con el equipo de ingeniería,

con el presupuesto y con el tiempo para

construir una solución a medida, parece una pieza

excelente para el puzzle tecnológico.

Pero si el objetivo es resolver un problema

de negocio, rápido y fiable, es fundamental entender

el coste y el esfuerzo total, no sólo

el precio de la herramienta.

La elección depende enteramente del objetivo final.

Y para terminar, un último apunte que invita

a pensar en el futuro.

Firecrawl está experimentando con un framework de agentes

llamado Fire1.

Ah, sí.

Usa Gemini 2 .5 Pro para interpretar la

intención del usuario y navegar por la web

de forma autónoma.

Y esto apunta a un futuro muy interesante.

Ya no sólo pedimos datos de una página,

sino que le damos a una IA un

objetivo.

Exacto.

Y que ella averigüe por sí misma, cómo

navegar, hacer clic y extraer lo que necesita.

La pregunta que queda en el aire es,

¿qué pasaría si en lugar de programar un

scraper, simplemente le diéramos a una IA un

objetivo de negocio y la dejáramos navegar por

la web para cumplirlo?

Y así hemos llegado al final por hoy.

Os recordamos que detrás de las voces sintéticas

que se escuchan en estos episodios, sí, son

generadas por IA, en concreto por Notebook LM,

pues se encuentra un humano con duodeno, pulgares

y algún michelin, entre otras cosas.

Estamos hablando de Julio Pablo Vázquez, el responsable

de elegir los temas, el enfoque y hacer

de hombre orquesta.

Si se escucha algún error, pedimos disculpas en

su nombre, porque lo más probable es que

se trate de un error humano.

Hasta la próxima, amigos.

Y hasta aquí el episodio de hoy.

Muchas gracias por tu atención.

Esto es BIMPRAXIS.

Nos escuchamos en el próximo episodio.