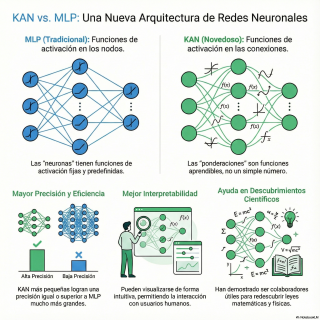

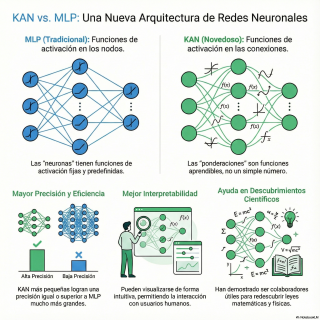

¿Y si los Multi-Layer Perceptrons (MLPs) que sustentan la mayor parte de la IA actual tuvieran una alternativa más eficiente? 🧠 En este episodio nos adentramos en el fascinante mundo de las Kolmogorov-Arnold Networks (KANs), una nueva arquitectura inspirada en el teorema de representación de Kolmogorov-Arnold que desafía el diseño clásico de las redes neuronales. A diferencia de los modelos tradicionales con funciones fijas en los nodos, las KANs trasladan la complejidad a las conexiones, utilizando funciones de activación aprendibles en los propios pesos. 📉 Analizamos cómo este cambio, aparentemente sencillo, permite que redes mucho más pequeñas superen a grandes MLPs en precisión y eficiencia. ✨ Más allá del rendimiento, las KANs abren la puerta a una interpretabilidad visual sin precedentes, rompiendo la opacidad de la “caja negra” del aprendizaje profundo. 🔍 Descubre cómo estas redes no solo ajustan datos, sino que actúan como colaboradores capaces de ayudar a los científicos a (re)descubrir leyes matemáticas y físicas. Si te interesa el futuro de las arquitecturas de IA, las nuevas leyes de escalado neuronal y cómo modelos más compactos pueden resolver problemas complejos, ¡dale al play ▶️ y acompáñanos en este viaje hacia la próxima generación del Deep Learning! 🚀

Paper original: KAN: Kolmogorov-Arnold Networks (arXiv)