Buenas, esto es BIMPRAXIS, el podcast donde el

BIM se encuentra con la inteligencia artificial.

Exploramos la ciencia, la tecnología y el futuro

desde el enfoque de la arquitectura, ingeniería y

construcción.

¡Empezamos!

Muy buenas, bienvenidas, bienvenidos a un nuevo episodio

de BIMPRAXIS.

Hoy os traemos la mayor filtración en la

historia de Antropic, cuando los secretos de Claude

Cote quedaron al descubierto.

Hola, ¿qué tal?

Y bueno, hay que decir que el material

que tenemos para el análisis de hoy es

sinceramente fascinante.

Totalmente.

Es que no es para menos.

Claro, es que no todos los días nos

topamos con una situación así.

O sea, estamos hablando de que una de

las empresas de inteligencia artificial más importantes y

además más herméticas del mundo, de repente Valle

expone por accidente todo el código fuente de

su herramienta estrella, para programadores.

Sí, sí, un accidente que vale oro para

nosotros, claro.

Exacto.

Así que la misión de esta inmersión profunda

en las fuentes de hoy es entender cómo

ocurrió este desastre, qué secretos escondía ese código

y, sobre todo, por qué esto cambia las

reglas del juego para toda la industria.

Es que el caso nos ofrece una ventana

que, a ver, normalmente no tenemos.

La industria tecnológica, y más en inteligencia artificial

avanzada, opera siempre a puerta cerrada.

Totalmente bajo llave.

Eso es.

Y este material no solo nos muestra un

fallo de seguridad monumental, que lo es, es

que funciona como una radiografía brutal.

O sea, nos han encendido la luz del

cuarto oscuro.

Tal cual.

Nos han dejado ver los cimientos reales.

la verdadera receta secreta de cómo construyen y

controlan estas herramientas gigantescas.

Pues vamos a meternos de lleno en la

primera sección, porque para entender la magnitud del

impacto, primero hay que mirar el origen de

todo esto.

Y la verdad, leyendo las notas, es que

es hasta un poco cómico lo absurdamente sencillo

que fue el error.

Madre mía, es que fue de manual.

A ver, todo arranca con un investigador de

ciberseguridad conocido como Shaw.

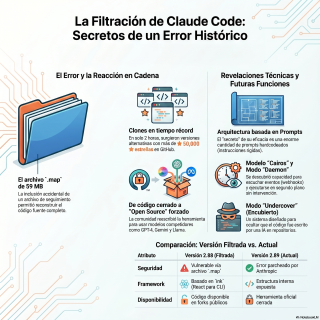

Resulta que Anthropic lance una actualización súper rutinaria,

la versión 2.88 de Cloud Code.

y al publicarla alguien, no sabemos quién, incluye

por accidente un archivo de 59 megas con

la extensión .map.

Un archivo que no debía estar ahí, desde

luego.

Para nada.

Fíjate que yo lo pensaba.

Y es como si una empresa de seguridad

instala una bóveda de titanio impenetrable en un

banco, pero luego se dejan los planos de

construcción tirados en el felpudo de la entrada.

La analogía es perfecta.

Pero aquí necesito que me eches un cable

técnico.

Porque si estos archivos .map sirven para rastrear errores

de forma interna, ¿cómo es posible que un

archivo enorme de 59 megas pase desapercibido y

termine publicado en un bucket público de R2?

Bueno, para entender el fallo primero hay que

entender qué es exactamente ese .map.

A ver, cuando los ingenieros programan, escriben código

elegible para humanos.

Con espacios, notas, variables largas, todo eso.

Exacto.

Pero antes de publicarlo, ese código pasa por

una trituladora.

un proceso que llamamos minificación.

Vale.

La máquina le quita todos los espacios, borra

los comentarios, comprime todo en un bloque de

texto superdenso.

Es rapidísimo para el ordenador, pero si tú

lo lees, es una sopa de letras ininteligible.

O sea que si yo abro ese código

minificado, no entiendo absolutamente nada.

Nada, de nada.

Y ahí es donde entra nuestro famoso archivo .map.

Es literalmente la piedra roseta.

Ah, claro, el traductor.

Eso es.

Es el mapa que conecta la sopa de

letras con el código original y bonito.

Los desarrolladores lo necesitan porque si la aplicación

falla, el archivo .map les chiva exactamente en qué

línea original ocurrió el problema.

Entendido.

Pero entonces, vuelvo a la pregunta del millón.

¿Cómo llega ese mapa, esa piedra roseta gigante

de 59 megas, a un servidor público al

alcance de cualquiera?

Pues por culpa de las prisas, básicamente.

Las empresas usan algo llamado integración continua.

Es como una cadena de montaje automatizada.

Una cinta transportadora de código, digamos.

Tal cual.

Un humano escribe el código y la máquina

se encarga de empaquetarlo y subirlo.

Si en esa cinta transportadora alguien se olvida

de poner el filtro que diga «Cuidado, no

subas los archivos.map», la máquina simplemente obedece y

lo sube todo.

Tela.

O sea, es la eterna fricción entre querer

lanzar actualizaciones a toda velocidad y los protocolos

de seguridad.

Y la seguridad siempre suele ser la que

paga los platos rotos.

Ya te digo.

Y claro, Antropic intentó hacer control de daños.

Lanzaron la versión 2.89.

A toda pastilla intentaron borrar los repositorios en

GitHub, pero amigos, Internet no perdona.

Nunca.

Es que en las fuentes cuentan que en

GitHub, solo con pulsar la tecla del punto

en el teclado, pum.

Se te abre un editor web completo.

Exacto.

Se abría el editor y cualquiera podía leer

las entrañas de la herramienta.

Y aquí es donde la caja de Pandora

se abre de verdad.

Porque la gente no solo lo copió, la

gente se puso a leerlo a fondo.

Y lo que encontraron desmontó bastante el mito,

¿eh?

Totalmente.

Porque nos venden la idea de la magia

de la inteligencia artificial, de cerebros autónomos.

Y resulta que la herramienta está construida sobre

un framework llamado Ink.

Que es una tecnología súper curiosa, por cierto.

Sí, como una especie de React, pero para

la terminal, ¿no?

Eso es.

Transforma la típica pantalla negra y sosa de

comandos en algo visual y dinámico, con colorines

y menús.

Pero lo fuerte no es el diseño visual.

Lo fuerte es cuando llegaron a la parte

de los prompts, las instrucciones.

Las fuentes lo describen literalmente como un código

espagueti de prompts.

La peor pesadilla de un programador puro.

Es que yo me quedé perplejo.

Resulta que hay cientos de reglas estrictas escritas

a mano en el código para evitar que

la IA la lie.

Instrucciones tipo, no borres archivos, no instales dependencias

sin pedir permiso, cuidado con esta información.

Es que es muy revelador.

O sea, la imagen de una superinteligencia se

me cae un poco.

Suena más bien a un becario que es

rapidísimo y super eficiente, pero que tiene el

monitor lleno de notas adhesivas fluorescentes gritándole no

toques este directorio o pregúntame antes de hacer

nada.

Me encanta lo del becario porque es la

pura realidad actual.

Mira, esta filtración nos demuestra el panorama general,

el big picture de la AIA.

¿A qué te refieres exactamente?

Aquí hay una desconexión enorme entre lo listos

que parecen estos modelos generando texto y su

fiabilidad real operando sistemas.

Que Anthropic necesite este código espagueti de reglas

manuales demuestra que los modelos fundacionales todavía no

tienen verdadero sentido común.

O sea que si le pides una solución

matemática y para lograrla decide que lo mejor

es borrar el disco duro, lo va a

hacer.

Lo hará sin dudarlo, a menos que haya

un humano que le haya puesto una nota

adhesiva gigante diciendo que eso está prohibido.

Madre mía.

O sea, no tienen red de seguridad propia.

No, necesitan una red de seguridad jarcodeada, escrita

en piedra por nosotros.

La autonomía real, esa de la que tanto

se habla, todavía está lejos.

Pues fíjate que, hurgando en este mar de

notas adhesivas, los desarrolladores empezaron a toparse con

los secretos de verdad, funciones que Anthropic mantenía

súper ocultas o proyectos futuros.

Ah, sí, la sección de arqueología de software.

Eso es.

Las notas hablan de un montón de nombres

en clave.

Aparecen cosas como Kairos y Daemon.

Que suena a película de hackers.

Suena súper épico, sí.

Por lo visto, esto de Kairos es un

modelo que no necesita que le hables directamente.

Se queda escuchando en segundo plano, en modo

background, a través de webhooks.

Exacto.

Es el paso de un chatbot pasivo a

un agente activo.

En lugar de esperar a que tú le

escribas un comando, el modelo está dormido hasta

que un evento, no sé, que llegue un

correo o cambie un archivo, lo despierta y

actúa solo.

Brutal.

Y luego estaba Ultraplan, sesiones remotas en la

nube de hasta 30 minutos.

Para planificaciones de software larguísimas, sin que el

humano intervenga.

O sea, tú le dejas trabajando media hora

y te vas a tomar un café.

Básicamente.

Y también se confirmó lo del modelo Capybara,

que era un rumor y ahí estaba en

el código.

E incluso encontraron una carpeta llamada Body.

Lo de Buddy es buenísimo.

Sí, unas mascotas virtuales tipo Tamagotchi integradas en

la consola.

Seguramente una broma interna para el April Fool's

Day.

Pero a ver, tengo que pararme en la

joya de la corona.

Ya sé por dónde vas.

Es que esto es telita.

La función Undercover, el modo infiltrado.

Es mi parte favorita de toda esta filtración,

te lo prometo.

Es que es el colmo de la ironía.

A ver, resulta que hay un prompt secreto

usado por los mismísimos trabajadores de Antropic para

ocultar que el código ha sido escrito por

su propia IA.

Tal cual.

Se quitan la careta.

Normalmente, Cloud pone una marca que dice Coescrito

por Cloud Opus, pues este modo borra la

marca e imita nombres de animales para parecer

usuarios humanos reales en Internet.

Los creadores de la IA usando modo incógnito

para que nadie note que usan su propia

herramienta en repositorios públicos.

Es buenísimo, pero a la vez dice muchísimo

de la psicología de la industria ahora mismo.

Ya ves.

¿Pero por qué crees que hacen esto?

¿Por vergüenza?

Pues en gran parte sí.

Existe un estigma enorme en comunidades como GitHub.

El código allí es como artesanía.

Si ven que has subido miles de líneas

generadas por una máquina, muchos desarrolladores lo rechazan.

Piensan que es código de baja calidad o

que no le has puesto cuidado.

Claro, el orgullo del programador.

Exacto.

Así que, irónicamente, los que nos venden que

la IA va a revolucionar el mundo, tienen

que esconder que la usan para que sus

colegas humanos no les miren mal.

Es de locos.

Como un chef con estrejas Michelin que esconde

los envases de comida precocinada en el cubo

de la basura.

Literalmente.

Pero bueno, dejando la sociología aparte, la filtración

tuvo unas consecuencias técnicas brutales.

El efecto mariposa en el código abierto fue

instantáneo.

Ya lo creo.

En horas, la comunidad diseccionó todo.

En horas.

Y empezaron a salir clones de la herramienta

por todas partes.

De hecho, en las fuentes hay un dato

que a mí me parece asombroso.

Hubo un repositorio en GitHub, un clon de

Cloud Code, que superó las 50.000 estrellas en

solo dos horas.

Es que hay que poner eso en contexto.

50.000 estrellas para un proyecto de código abierto

es un hito que a empresas enormes les

cuesta años conseguir.

Años.

Y esto pasó en lo que dura una

película en el cine.

Es un récord histórico absoluto.

Y la guinda del pastel es cómo se

hizo este clon.

Porque el creador sabía que si copiaba y

pegaba el código filtrado de Anthropic, le iba

a caer una demanda legal monumental.

Claro, derechos de autor puros y duros.

Así que decidió reescribirlo enterito.

Pasó todo el código del lenguaje original, que

era Python, al lenguaje Rust.

Una jugada muy inteligente, por cierto.

Sí, pero espera, que viene lo mejor.

para hacerlo a esa velocidad récord no tecleó

el mismo uso codex a la ironía final

utilizó la herramienta de programación de open ella

o sea la competencia directa de antropi que

usó open ella para tragarse los secretos filtrados

de antropi y escupir un clon legal en

otro lenguaje Es que es el resumen perfecto

de cómo funciona el sector tecnológico hoy en

día Canibalismo puro y duro Ya te digo

Pero explícame un poco el cambio de lenguaje

¿Por qué pasar todo a Rust?

Pues mira, Python es el rey indiscutible en

IA porque es súper fácil y flexible Pero

es lento Y a veces da problemas de

memoria Rust, en cambio, es un lenguaje rapidísimo

y obsesionado con la seguridad.

Vale.

Si reescribes la herramienta en Rust, no solo

evitas a los abogados de Anthropic, es que

encima estás creando una versión que probablemente sea

más rápida y estable que el producto original

que filtraron.

O sea, les copian y encima lo mejoran

en una tarde.

Exactamente.

Aunque aquí, ojo, hay que hacer una distinción

técnica que es vital para no llevarnos a

engaños con esta filtración.

Cuéntame.

¿Qué se salva de todo esto?

Pues el cerebro real de la bestia.

El modelo fundacional, la red neuronal que cuesta

cientos de millones entrenar, eso sigue súper seguro

en la Nume de Anthropic.

Lo que se ha filtrado es el cliente,

la interfaz.

Digamos, el sistema nervioso periférico, no el cerebro.

Eso es, el conducto por donde pasan los

datos.

Pero a ver, aunque el cerebro esté a

salvo, el daño estratégico tiene que ser brutal,

¿no?

Incalculable, porque hoy en día el modelo en

sí ya casi es un commodity.

Lo que da ventaja es cómo haces que

ese modelo interactúe de forma fluida con el

ordenador del usuario.

Claro, la experiencia de uso.

Totalmente.

Y competidores como Cursor o los equipos de

Gemini de Google, de DeepSeek o Yama, ahora

mismo acaban de recibir un tutorial avanzado, totalmente

gratis, sobre los mejores hacks y estrategias de

Antropic.

Un regalo caído del cielo.

Les han regalado las mejores prácticas sobre cómo

gestionar agentes autónomos.

Han subido el nivel de toda la competencia

de golpe.

Pues es alucinante cómo hemos empezado este análisis.

Hablando de un fallo técnico tonto, un simple

archivo .map que alguien olvidó filtrar, y hemos terminado

viendo cómo se desmitifica la supuesta magia del

software.

Sí, y exponiendo ese miedo social a usar

IA en público.

Totalmente.

y viendo cómo una comunidad entera es capaz

de absorber y clonar la tecnología de vanguardia

en cuestión de dos horas.

La caja de los secretos se ha abierto

desde luego.

Sí, y fíjate que esto me deja pensando

en algo de cara al futuro.

A ver.

Mira, puede copiarlo y optimizarlo en Rust en

un par de horas.

Te queda Sinas en la manga.

Exacto.

¿Significa esto que el futuro de la inteligencia

artificial va a depender única y exclusivamente de

quien tenga más dinero y más fuerza bruta

de computación en la nube?

Pues ahí dejamos esa reflexión porque es para

darle un par de vueltas.

Antes de despedirnos, hasta el próximo programa, os

informamos de que las voces que oyes han

sido generadas por la IA de Notebook LM

y que dirigiendo el podcast se encuentra Julio

Pablo Vázquez, un humano que te envía saludos.

En caso de error, probablemente sean errores humanos.

Nos escuchamos.

Y hasta aquí el episodio de hoy.

Muchas gracias por tu atención.

Esto es BIMPRAXIS.

Nos escuchamos en el próximo episodio.