Buenas, esto es BIMPRAXIS, el podcast donde el

BIM se encuentra con la inteligencia artificial.

Exploramos la ciencia, la tecnología y el futuro

desde el enfoque de la arquitectura, ingeniería y

construcción.

¡Empezamos!

Hola humanas y humanos, aquí estamos con un

episodio nuevo de BIMPRAXIS.

En el episodio de hoy, el número 53,

seguimos profundizando en el uso de grafos para

mejorar la calidad de los sistemas de generación

aumentada por recuperación, o RAG para los amigos.

Ya sabéis, dentro de nuestra serie dedicada a

los RAG.

Hoy venimos con un paper académico y varias

fuentes expertas que explican una técnica, bueno, fascinante,arxiv

llamada GraphRAG.

Vamos a desgranar de qué va todo esto.

Para empezar, y para que todo el mundo

se sitúe, recordemos un poco cómo funciona un

sistema RAG básico.

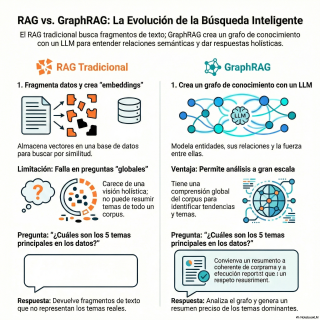

El proceso habitual, según explican las fuentes, es

coger un montón de documentos, partirlos en trocitos

más pequeños, en chunks, sí, eso es, y

luego convertirlos en vectores, en números, y guardarlos

en una base de datos vectorial.

Y cuando alguien pregunta algo, pues el sistema

busca los trozos más parecidos y con eso

genera la respuesta.

Exacto.

Es un sistema de recuperación de información muy

potente, la verdad.

Pero tiene una limitación fundamental.

Y el paper From Local to Global la

identifica muy, muy claramente.

Falla estrepitosamente con lo que llaman preguntas globales.

¿Preguntas globales?

¿A qué se refieren con eso?

Pues mira, es una pregunta que no busca

un dato concreto, un trocito de información.

busca una comprensión del conjunto de datos entero.

Por ejemplo, una pregunta como ¿cuáles son los

temas principales de este corpus de documentos?

Ah, claro.

Un RAG convencional buscará fragmentos que tengan las

palabras temas o principales y, bueno, seguramente da

una respuesta bastante pobre o directamente irrelevante, porque

es una tarea de resumen, no de recuperación

pura y dura.

Vale, entiendo.

O sea que el RAG tradicional se queda

corto para entender el bosque, se centra demasiado

en los árboles.

Y es aquí, supondo, donde entra la propuesta

de las fuentes.

GraphRAG.

Lo describen como un proceso en dos pasos.

Sí.

El primer paso es la indexación.

Ahí se usa un modelo de lenguaje grande,

un LLM, para crear un grafo de conocimiento

a partir de todos los datos.

Y el segundo paso es, una vez tienes

ese grafo, usarlo para organizar una recuperación de

información que es muchísimo más inteligente.

Grafo de conocimiento.

Es un término que impone un poco.

Bueno, pero es más sencillo de lo que

parece.

A ver.

A diferencia de una base de datos normal,

con sus filas y columnas, un grafo de

conocimiento tiene nodos y aristas.

Vale.

Los nodos son las entidades, personas, empresas, conceptos.

Y las aristas son las relaciones entre esos

nodos.

Y lo interesante es que tanto los nodos

como las aristas pueden guardar información.

O sea, la línea que los une también

tiene datos.

Exacto.

Un ejemplo que hemos visto todos es la

tarjeta de información que sale en Google o

en Bing cuando buscas una persona famosa.

Ah, la ficha de la derecha.

Esa misma.

Eso se extrae de un grafo de conocimiento.

Aquí es donde la cosa se pone, para

mí, realmente interesante.

La clave de GraphRag no es solo identificar

las entidades en un texto, sino entender las

relaciones que hay entre ellas.

Y una de las fuentes da un ejemplo

que es buenísimo.

La frase es, la líder del PEO, Silvia

Mar, subió al escenario con Luke Jack, fundador

de Save Our Wildlands.

Vale, un sistema normal identificaría a Silvia Mar,

PEO, Luke Jack y Save Our Wildlands, cuatro

entidades.

Pero aquí un modelo como GPT-4 va mucho

más allá.

Entiende la semántica, entiende que la relación entre

Silvia Mar y el PEO es fuerte porque

es la líder.

Claro, es una relación estructural.

Eso es.

En cambio, su relación con Save Our Wildlands

es débil, es circunstancial, solo comparte escenario con

su fundador.

¡Ostras, qué bueno!

Esto lo que crea es un grafo ponderado,

con relaciones que tienen distinta fuerza.

Y eso es mucho más rico que una

simple red de palabras que aparecen juntas.

Y después, sobre este grafo se aplican técnicas

de Machine Learning de grafos para agrupar los

nodos en comunidades semánticas.

Vale, espera.

Comunidades semánticas.

Sí.

Básicamente agrupa los conceptos que están muy relacionados

entre sí, creando como temas o clústeres.

Y eso te da una estructura jerárquica que

te permite hacer consultas a distintos niveles de

detalle.

La teoría suena muy bien, pero vamos a

la práctica.

Las fuentes incluyen demostraciones que muestran la diferencia

de una forma, bueno, espectacular.

La primera usa un conjunto de 3.000 artículos

sobre el conflicto entre Rusia y Ucrania.

Un tema muy denso, sí.

Y la pregunta es, ¿qué es Novorossia y

cuáles son sus objetivos?

Los resultados aquí son reveladores.

Un RAG básico, sin más, falla.

No sabe qué responder.

Un RAG que llaman mejorado o afinado, responde

a la primera parte, te explica qué es

Novorossia, pero no llega a la segunda.

¿Y Graf RAG?

La diferencia es abismal.

No solo explica qué es Novorossia, sino que

da una lista de objetivos súper específicos que

ha sacado de los documentos.

¿Ah, sí?

¿Como cuáles?

Pues mira, la Compañía Nacional de Televisión de

Ucrania, una emisora de radio, un banco privado,

propiedades de Roshan e incluso planes de ataques

en Odessa.

¡Guau!

Y supongo que lo más importante es que

puedes rastrear de dónde saca cada cosa.

Para evitar alucinaciones.

Totalmente.

Cada afirmación está vinculada al fragmento de texto

original.

Esto te permite verificar la información, que es

crucial.

Y esto nos lleva de vuelta a las

preguntas globales, al gran problema.

Le preguntaron al sistema, ¿cuáles son los cinco

temas principales de los datos?

Y aquí, el RAG básico dio respuestas genéricas,

cosas como, estado de la economía rusa.

¿Cuándo el 80% de los artículos iban sobre

el conflicto.

Exacto.

Ignoró el tema principal.

GraphRAG, en cambio, identificó el conflicto como el

tema central, sin dudarlo.

Claro, porque tiene esa visión de conjunto.

Hay una contrapartida, eso sí.

GraphRAG es más costoso computacionalmente.

Mucho más.

En el ejemplo, usó 50.000 tokens y tardó

71 segundos.

El RAG básico, 5.000 tokens y 8 segundos.

Uf, es bastante diferencia.

Sí, pero la calidad y la corrección de

la respuesta son inmensamente superiores.

Al final es un trade-off.

¿Quieres rapidez o quieres precisión?

Hay otra demostración que me pareció muy visual.

Se hizo con las transcripciones del podcast Behind

the Tech de Kevin Scott.

Sí, ese caso es fascinante.

Ahí el LLM construyó el grafo de conocimiento

desde cero.

En la visualización, cada nodo era una entidad

y los colores representaban, digamos, los temas, las

particiones semánticas.

Y lo fascinante es cómo agrupó las cosas.

Sí, porque identificó una comunidad semántica sobre biología

y en el mismo clúster, en el mismo

grupo, junto a dos expertos diferentes.

Drew Endy y David Baker.

Vale, ¿y qué tiene eso de especial?

Pues que aparecieron en episodios distintos.

Nunca hablaron entre ellos.

Espera, ¿me estás diciendo que el sistema los

agrupó solo porque se dio cuenta de que

los dos hablaban de lo mismo, aunque fuera

en momentos diferentes y sin mencionarse?

Exactamente eso.

No se basó en que sus nombres aparecieran

juntos.

Se basó en que entendió las conexiones temáticas

que había debajo de sus conversaciones.

Es la prueba de que de verdad entiende

el contenido.

Desde luego.

Demuestra que no solo recupera, sino que comprende.

Entonces, después de ver todo esto, ¿qué significa?

¿Cuál es la gran conclusión?

Significa que GraphIRG no es sólo una mejora

incremental, es un cambio de paradigma.

¿De qué manera?

Pasamos de la recuperación local de fragmentos de

texto, que es lo que teníamos, a la

creación de una memoria estructurada, una comprensión global

de todo un corpus.

¿De lo local a lo global, como el

título del paper?

Justo eso, es exactamente lo que resume.

Esto plantea una pregunta interesante, creo.

Todo esto se basa en que un LLM

construye estos grafos de forma autónoma, Pero para

dominios de alto riesgo como la medicina o

el derecho, ¿podríamos fiarnos de un sistema así?

Esa es la gran pregunta.

¿Podemos ver sistemas híbridos en el futuro?

Sistemas que combinen la escala de la IA

con la precisión y la verificación del conocimiento

humano.

¿Cómo funcionaría eso?

Pues imagina un sistema donde el LLM propone

un primer borrador del grafo y luego expertos

humanos, médicos o abogados lo revisan, lo curan…

Lo validan.

Exacto.

Creando sistemas RAG que serían aún más fiables

y robustos.

Podría ser el siguiente paso.

Bueno, pues con esa reflexión nos despedimos por

hoy.

No sin antes recordar que las voces que

escuchas son generadas por una IA, por Notebook

LM.

Pero el podcast no se genera de forma

automática.

Detrás de todo lo que escuchas hay un

humano, que os manda saludos.

Se llama Julio Pablo Azquez y está encantado

de que el podcast cada vez tiene más

suscriptores.

Muchas gracias y hasta el próximo episodio.

Y hasta aquí el episodio de hoy.

Muchas gracias por tu atención.

Esto es BIMPRAXIS.

Nos escuchamos en el próximo episodio.

SUSCRÍBETE 🙏