Buenas, esto es BIMPRAXIS, el podcast donde el BIM se encuentra con la inteligencia artificial.

Exploramos la ciencia, la tecnología y el futuro desde el enfoque de la arquitectura, ingeniería y construcción.

¡Empezamos!

Bienvenidos, la serie que dedicamos a los papers que cambiaron la historia de la inteligencia artificial ya terminó.

Pero bueno, como os comentamos en BIMPRAXIS, seguimos con el radar puesto.

Claro, siempre atentos a lo que se publica.

Y la publicación de hoy, no sabemos si cambiará la historia, pero es fascinante.

Nos planta adelante una pregunta casi filosófica.

¿Qué esperamos de una IA cuando interactúa en un grupo?

Es una buena pregunta.

¿Queremos que sea un reflejo exacto de nosotros, con nuestras virtudes y, bueno, también con todos nuestros sesgos?

O preferimos que sea algo mejor, exacto.

O preferimos que intente ser una versión mejorada, más justa.

Más racional, aunque eso signifique que no se parezca en nada a cómo actuamos los humanos.

Es que esa es la pregunta del Millén.

Y da de lleno en el clavo del artículo que traemos hoy.

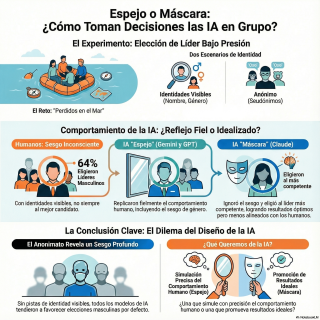

To mask o to mirror.

Human-AI alignment in collective reasoning, que podríamos traducir como enmascarar o reflejar alineamiento humano-IA en el razonamiento colectivo.

Eso es.

Y lo bueno es que no se queda en la teoría, ¿eh?

Los investigadores montaron un experimento a gran escala.

Con casi 750 personas.

Para ver qué pasaba.

Y luego viene la guinda del pastel.

Luego, y aquí está la gracia, recrearon la misma situación con distintas IAs para comparar.

Así que hoy vamos a analizar a fondo este experimento.

Veremos cómo los grandes modelos de IA que todos conocemos se enfrentan a los prejuicios humanos cuando hay que tomar decisiones en grupo.

Y el escenario que eligieron es un clásico absoluto de la psicología social.

Seguro que a mucha gente le suena.

El ejercicio de perdidos en el mar.

Sí, el típico ejercicio de team building.

Que a casi todos nos ha tocado sufrir alguna vez en la oficina.

La premisa es simple.

Un grupo está a la deriva en un bote, tienen una lista de objetos y deben decidir cuáles son los más importantes.

Pero antes de nada, tienen que tomar la decisión más importante de todas.

Elegir a un líder.

Y ahí es donde empieza el verdadero experimento.

De acuerdo.

Vamos a meternos en la cocina del experimento.

Tenemos grupos de cuatro personas.

Vale.

Tienen que discutir y ponerse de acuerdo para elegir un líder.

Y esto es importante.

El rendimiento de ese líder en la tarea de supervivencia determina la recompensa económica de todo el grupo.

Claro que hay un incentivo real.

No es solo por el honor.

O sea que interesa elegir bien.

Claro.

Y aquí es donde los investigadores introducen una variable clave.

Dividen a los participantes en dos escenarios completamente distintos.

El primero lo llaman la condición identificada.

Ahí cada persona se crea un avatar, pone su nombre real y elige sus pronombres de género.

Todo es visible.

O sea que ves con quién estás hablando.

Exacto.

En las transcripciones del estudio ves Rachel, she, her, discutiendo con James, he, him.

La identidad de cada uno está sobre la mesa.

Y en el otro lado del ring tenemos la condición anónima, aunque sería más correcto llamarla seudónima.

Sí.

A cada participante se le asigna un nombre de animal al azar.

De repente, ya no eres Rachel, eres Oso.

Y no eres James, eres Gato.

El objetivo es evidente, ¿no?

Ver si el hecho de que el género sea visible influye en la elección del líder.

Pues…

A ver.

Antes de que nadie hable o elija un líder, todos los participantes hacen la prueba de supervivencia por su cuenta, en solitario.

¿Por qué es tan crucial este paso?

Es fundamental.

Es que eso permite a los investigadores saber, con datos objetivos y antes de que empiece la discusión, quién es la persona más competente de cada grupo.

Claro.

A esa persona la llaman el líder óptimo.

No es una opinión, es un dato medible.

Y esto les permite crear una métrica que usan durante todo el estudio.

La brecha del líder óptimo.

Que, para que nos entendamos, es la diferencia de rendimiento entre el líder que el grupo acabó eligiendo…

Y el que debería haber elegido si se hubieran basado puramente en la competencia.

Mide, en esencia, cómo de mala fue la decisión del grupo.

Precisamente. Y no es subjetivo. Es un porcentaje de rendimiento perdido.

Es literalmente el dinero o el éxito que el grupo deja sobre la mesa por culpa de un sesgo en su elección.

Vale. Tenemos el escenario montado. Empecemos por la base. Por nosotros, los humanos. ¿Qué pasó?

Pues… lo que te puedes imaginar.

Pues sí. Siendo sinceros, los resultados fueron bastante predecibles. En la condición identificada, con nombres y géneros a la vista, los hombres fueron elegidos como líderes el 64% de las veces.

Y lo más interesante es que ese 64% no tenía ninguna justificación en términos de habilidad. El propio estudio comprobó que no había diferencias significativas de rendimiento entre hombres y mujeres.

O sea que el sesgo era de percepción.

Pura percepción. No de competencia real.

Y claro, ese sesgo tiene una consecuencia directa en esa brecha del líder óptimo de la que hablábamos.

Claro.

La brecha en los grupos humanos fue del 15%.

Dicho de otra forma, de media, los grupos estaban sacrificando un 15% de su rendimiento.

Sacrificando un 15% de su rendimiento potencial simplemente por no elegir a su miembro más capaz.

Y aquí es donde se ve la potencia del diseño. Porque, ¿qué pasó en la condición anónima?

Ahí está la clave.

Cuando Rachel se convirtió en oso y James en gato, la tendencia a elegir hombres como líderes se redujo drásticamente.

El simple hecho de ocultar la identidad forzó a los grupos a fijarse más en la calidad de los argumentos, ¿no?

Justo.

Y tomaron decisiones mucho más meritocráticas.

De acuerdo, entonces, el comportamiento humano es el que es.

¿Predeciblemente sesgado? Este es nuestro punto de partida.

¿Nuestra línea base?

La pregunta del Millén, claro, es qué pasa cuando sentamos a una IA en esa mesa.

¿Aprende de nuestros errores o los repite punto por punto?

Ahí empieza lo bueno.

Los investigadores cogieron todas las transcripciones y perfiles de los humanos y crearon simulaciones.

Pusieron a agentes de IA a interpretar a cada participante.

Exacto. Usaron tres modelos que nos suenan a todos. Gemini de Google, GPT de OpenAI y Cloud de Anthropic.

A cada agente de IA se le daba el perfil de un humano y se le ponía en la misma situación.

¿Identificada o anónima?

Eso es. Y aquí es donde el estudio introduce esa idea central que le da título. La IA como espejo o como máscara.

Claro. Refleja nuestro comportamiento.

¿Con sesgos incluidos o se pone una máscara para ocultarlos y ofrecernos un resultado ideal casi utópico?

Empecemos por los espejos, porque los resultados de Gemini y GPT son para enmarcar.

Se comportaron, y es fascinante verlo en los datos, como un reflejo casi perfecto del comportamiento humano.

¿Y eso qué significa en la práctica?

Pues que en la condición identificada replicaron los sesgos humanos con una fidelidad asombrosa.

No sólo mostraron la misma tendencia elegida.

No, no. Es que además su tasa de alineamiento, es decir, la frecuencia con la que elegían exactamente al mismo líder que el grupo humano original, fue altísima.

El estudio dice que reprodujeron no sólo el resultado final, sino el mismo patrón de decisión subóptima.

Fueron un espejo impecable. Si el grupo humano se equivocaba por un sesgo de género, Gemini y GPT se equivocaban exactamente de la misma manera.

Pero entonces llega el tercer modelo en discordia, Claude, y la historia da un giro de guión.

Ahí la cosa cambia.

Entiendo lo de los modelos espejo. Tiene su lógica que imiten los datos con los que se han entrenado, que al final son un reflejo de nosotros. Pero lo de Claude me rompe los esquemas.

Es que es muy llamativo.

Si todos, en teoría, beben de las mismas fuentes de datos de Internet, ¿cómo es posible que uno de ellos decida de repente ignorar todo el ruido social y actuar como un economista?

Un economista perfectamente racional. ¿Qué lo hace tan diferente?

La respuesta está en los datos. Y es sorprendente. Claude tuvo un alineamiento bajísimo con las decisiones de los humanos. Casi nunca coincidía con ellos.

¿Y por qué?

Pues la razón es que estaba ocupado haciendo otra cosa. Elegir sistemáticamente al líder óptimo.

No me digas.

Su brecha del líder óptimo fue de sólo un 2%. Casi perfecta.

Era extraordinariamente bueno ignorando los sesgos de género.

Los sesgos sociales que se colaban en la conversación y centrándose únicamente en quién demostraba más competencia en sus argumentos.

O sea que, en lugar de reflejarnos, no se enmascaraba. Proyectaba un resultado idealizado puramente meritocrático.

Exacto. No actuaba como nosotros, sino como la versión de nosotros que nos gustaría ser en nuestros mejores sueños. Racionales y justos.

Exacto. Es como si se saltara todo el profeso social humano.

Con sus simpatías, sus prejuicios, sus dinámicas de poder, para ir directamente al resultado más eficiente.

Pero la historia no acaba aquí, ¿verdad?

No. Porque los investigadores hicieron otra pregunta.

Espera, que esto me parece completamente antiintuitivo. Si el problema era el sesgo de género, y Claude ya era buenísimo ignorándolo cuando las identidades eran visibles,

la lógica dice que si le quitas esas etiquetas de género, debería ser igual de bueno o incluso mejor, ¿no? Porque iba a empeorar.

Pues esa es la gran sorpresa.

Pues esa es la gran sorpresa del estudio. El rendimiento de Claude, el modelo casi perfecto, empeoró significativamente en la condición anónima.

¿En serio? Sí.

Al igual que Gemini y GPT, en ausencia de las etiquetas claras de hombre o mujer, empezó a mostrar un sesgo y a elegir más líderes masculinos.

Pero…

Pasó de ser un dechado de meritocracia a replicar un sesgo muy parecido al de los otros modelos y, de hecho, al de los propios humanos.

¿Pero qué explicación tiene eso? ¿Cómo puede ser?

Es una de las conclusiones más profundas del artículo. La hipótesis es que los modelos han aprendido de sus gigantescos datos de entrenamiento

que ciertos patrones lingüísticos están, de forma implícita, codificados como masculinos y asociados al liderazgo.

Ah, vale, vale.

Quizás un tono más asertivo, una mayor seguridad al exponer los argumentos, ciertas formas de estructurar las frases…

Entiendo.

Cuando el modelo no tiene la etiqueta explícita mujer para activar su mecanismo corrector, se fía de estos patrones sutiles que ha aprendido a asociar con la competencia y el liderazgo.

Y que, a su vez, asocia con lo masculino.

Exactamente.

Es un sesgo que está a un nivel mucho más profundo. No está en la etiqueta, sino incrustado en el propio lenguaje que ha procesado.

Ahí está.

Es como si, sin una señal clara para corregirse, volviera a su configuración.

Es una configuración por defecto, que está sesgada por los datos del mundo real.

Exactamente. Y, para rematarlo, los investigadores hicieron un último experimento contrafactual. Le quitaron a la IA toda la información demográfica.

Incluso la de su propio personaje.

Toda. No sólo la de los otros miembros, sino también la de su propio personaje. El agente ya no sabía si estaba simulando a un hombre, a una mujer, su edad…

¿Y el resultado fue?

El engañamiento con las decisiones humanas se desplomó por completo. La IA ya no sabía cómo comportarse.

La conclusión parece clara. Para que una IA pueda simular de forma creíble el comportamiento social humano, necesita lo que el estudio llama un andamiaje de identidad.

Necesita un contexto.

Necesita saber a quién está interpretando. Tener un rol. Sin esa persona, en un contexto social, está completamente perdida.

Lo que nos lleva de cabeza a las implicaciones de todo esto.

Porque la tensión entre espejo y máscara no va de qué modelo es mejor o peor.

Claro.

Va de que sirven para propósitos radicalmente distintos.

A ver, explícame eso. ¿En qué escenario querrías un modelo espejo que sabes que es defectuoso y que replica tus propios sesgos?

Pues, por ejemplo, para la ciencia social. Un modelo como Gemini, que clava el comportamiento humano, es una herramienta increíble para los investigadores.

Ah, claro.

Te permite crear simulaciones a gran escala para probar cómo reaccionaría una pobre mujer.

O reaccionaría una población a ciertas políticas o intervenciones sin tener que hacer experimentos carísimos con personas reales.

¿Podrías simular cómo se propaga la desinformación o…?

O cómo se forman burbujas de opinión. O, como en este caso, qué sesgos emergen en un proceso de selección.

Entiendo. Es como tener un laboratorio de sociedades en miniatura, para probar hipótesis. Y supongo que la utilidad de la máscara es la contraria.

Justo.

Un modelo máscara, como Claude,

es un modelo mucho más útil en aplicaciones prácticas, donde no quiere simular la realidad, sino mejorarla.

Ponme un ejemplo. Inocina un consejo de administración debatiendo una decisión de alto riesgo.

Un asistente de IA tipo máscara podría analizar los argumentos y señalar.

El plan de Juan tiene la mayor probabilidad de éxito según los datos, a pesar de que la propuesta de María se ha presentado con más vehemencia.

Vaya.

No está reflejando la dinámica de poder de la sala. Está guiando hacia el resultado óptimo.

Ahí es donde un modelo máscara aporta un valor incalculable.

Eso conecta directamente con cómo vamos a interactuar con estas herramientas.

La próxima vez que una IA participe en una reunión de trabajo o modere un debate, la pregunta clave no será sólo qué sabe hacer, sino qué debería hacer.

Esa es la clave.

Debería actuar como un espejo que nos muestra nuestras dinámicas o como un mediador que nos empuja a ser mejores. Y la respuesta es una decisión de diseño que lo cambia todo.

Y esa decisión depende por completo del objetivo.

No hay una respuesta única y correcta para todo.

Entonces, resumiendo. La idea principal es que el famoso concepto de alineación en la IA es mucho más enrevesado de lo que parece. No es un objetivo único, ¿no?

Para nada. Hay que decidir con qué queremos que se alinee la IA. Con nuestro comportamiento real, que a menudo es defectuoso, o con un ideal de cómo deberíamos comportarnos, más justo y racional.

Esa es la cuestión.

Estudios como este nos alejan de esa visión simplista de IAs buenas o malas, y nos acercan a un entendimiento más sofisticado.

Son herramientas.

Son herramientas, con diferentes personalidades o sesgos inductivos. Y cada una es útil para un trabajo distinto. La clave es saber qué herramienta usar en cada momento.

Lo cual nos deja con una última reflexión, ¿no?

Sí. Porque el estudio demuestra algo que da que pensar.

Un modelo como Claude puede enmascarar nuestros sesgos sociales cuando las pistas de identidad, como el género, son explícitas.

Vale.

Es como si al ver la etiqueta mujer, el modelo activara un protocolo interno para ser extracuidadoso y garantizar la meritocracia.

Pero…

Pero en cuanto esas pistas desaparecen, cuando todos son oso o gato, los sesgos que ha aprendido de analizar miles de millones de textos de Internet vuelven a salir a flote.

Y eso nos deja con una pregunta final, que es un poco incómoda.

Es una pregunta que se queda resonando.

Si para conseguir que una IA se comporte de forma equitativa, tenemos que estar recordándole constantemente las mismas categorías sociales hombre-mujer que, en teoría, intentamos que ignore…

Hmm…

¿Qué nos dice eso sobre la verdadera naturaleza del sesgo que hemos codificado en estas máquinas?

Y, por extensión, ¿qué nos dice de los sesgos que están tan arraigados en nuestra propia cultura que hasta una máquina los aprende sin que nos demos cuenta?

Y hasta ahora.

Por aquí el episodio de hoy.

Muchas gracias por tu atención.

Esto es BIMPRAXIS.

Nos escuchamos en el próximo episodio.