Buenas, esto es BIMPRAXIS, el podcast donde el BIM se encuentra con la inteligencia artificial.

Exploramos la ciencia, la tecnología y el futuro desde el enfoque de la arquitectura, ingeniería y construcción.

¡Empezamos!

Hola y bienvenidos. Hoy nos sumergimos en un documento que, bueno, es muy muy reciente,

pero que ya está agitando las aguas de una forma que se siente histórica.

Totalmente.

Es uno de esos papers que, desde el momento en que se publican, sabes que van a definir la conversación durante mucho tiempo.

Y es que, aunque sea de 2024, encaja a la perfección en esta serie que estamos haciendo.

Para ponerlo en contexto, este es el episodio número 15 de la serie especial de BIMPRAXIS.

Los papers que cambiaron la historia de la IA.

Exacto. Y este, sin duda, ya se ha ganado un sitio en esa lista. Es como si un nuevo titán acabase de entrar en la arena.

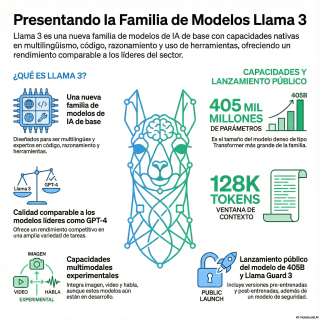

El titán se llama The Llama 3, Heard of Models.

O...

La manada de modelos, Llama 3.

Se publicó en el repositorio Archive en julio de 2024, con una revisión en noviembre.

Y aquí va el primer dato que te obliga a releer la frase.

A ver.

Lo firman 559 autores. 559.

Es una cifra que parece una errata, pero no lo es. Y nos dice muchísimo antes incluso de leer el resumen.

Ya me imagino.

Una autoría tan masiva es el reflejo de una nueva era en la investigación de la IA.

Esto ya no es el trabajo de un pequeño laboratorio académico, ¿sabes?

Claro.

Es un esfuerzo industrial, una obra de ingeniería a la escala de construir una presa o lanzar un programa espacial.

Es la manifestación de los recursos monumentales que se necesitan hoy.

Imagínate intentar coordinar la agenda de 559 personas para una reunión.

Más allá de la logística, lo que esto nos indica es la complejidad del proyecto.

Sin duda.

Así que nuestra misión hoy es precisamente esa.

Desentrañar qué es exactamente la materia.

¿Por qué su publicación es un evento tan significativo?

Y sobre todo, ¿qué nos dice sobre la estrategia y la dirección que está tomando la inteligencia artificial?

Pues vamos a ello.

Empecemos a desentrañar este gigante.

Por el principio, que como dices, es el propio nombre.

Exacto. El título habla de A Herd of Models, una manada de modelos.

No es el modelo Lama 3, sino una manada.

¿Es solo un marketing poético o hay algo más?

¿Hay algo más detrás de esa palabra?

No, no, para nada. Hay mucho más.

Es una elección de palabras muy deliberada y, de hecho, muy técnica.

¿Ah, sí?

Sí. Según el paper, Lama 3 no es una sola entidad, sino un conjunto de modelos fundacionales.

Vale, modelos fundacionales.

Un modelo fundacional es como el motor de un coche.

Es la pieza central, preentrenada con una cantidad salvaje de datos,

sobre la cual se pueden construir aplicaciones más específicas.

Entiendo.

La idea de manada transmite que no te dan un supuesto.

No es un solo motor, sino toda una gama.

Tienes motores de distintos tamaños, potencias y especializaciones, listos para diferentes tareas.

O sea, desde un utilitario ágil hasta un camión de mercancías, por así decirlo.

Justo. Esa es la idea.

Entendido. Y el documento dice que estos motores soportan nativamente varias capacidades clave.

Multilingüismo, programación, lo que llaman coding, razonamiento y uso de herramientas.

Ajá.

La palabra clave ahí parece ser nativamente.

¿Por qué es tan importante que esas habilidades sean nativas y no, digamos, aprendidas?

Lo fascinante aquí es que la palabra nativamente sugiere una diferencia filosófica en el diseño.

No es un añadido posterior, no es un parche.

Claro.

Significa que esas habilidades han sido integradas en la arquitectura central del modelo desde las primeras fases de su entrenamiento.

En la práctica, esto las hace mucho más robustas y eficientes.

Analogía.

¿Verdad? Es como si, en vez de ser un políglota que después aprende a programar,

fuera un ser que nació hablando fluidamente idiomas humanos y lenguajes de máquina al mismo tiempo.

Esa es una excelente analogía. Perfecta. No es un modelo de lenguaje al que le han enseñado trucos de programación.

Ya.

Es un sistema que, desde su concepción, fue diseñado para tratar el código de Python con la misma naturalidad que el español o el inglés.

Y eso se aplica también al razonamiento y al uso de herramientas.

Exacto.

Porque está diseñado desde cero para poder seguir cadenas lógicas complejas e interactuar con otras aplicaciones,

no como una habilidad que se le fuerza después.

Exactamente.

Y supongo que para que esa capacidad nativa sea realmente potente,

tiene que estar respaldada por una escala y unas cifras que la sitúen en la élite.

Claro.

Y aquí es donde los números se ponen realmente interesantes.

El paper destaca su modelo más grande.

Un transformer denso de 405 millones.

Un momento. Antes de seguir, aclaremos eso de transformer denso.

Para quien no esté familiarizado, transformer es la arquitectura neuronal que revolucionó el campo y es la base de todos estos gigantes.

Cierto.

Y denso simplemente significa que, a grandes rasgos, todas sus neuronas virtuales están interconectadas entre sí, creando una red increíblemente compleja.

Gracias por la aclaración.

Entonces, ese transformer denso tiene 405 millones de parámetros.

¿Cómo podemos visualizar esa cifra?

Es complicado, porque las cifras son astronómicas.

Los parámetros son, en esencia, las conexiones ajustables dentro de esa red neuronal.

Son como las sinapsis en un cerebro, las que le permiten aprender patrones.

Vale.

405 mil millones de parámetros lo colocan directamente en la liga de los modelos más grandes y potentes que existen en el mundo.

O sea, al nivel de los grandes conocidos.

Sí. Modelos como GPT-4 de OpenAI.

Aunque sus cifras exactas no son públicas, se estima que se mueven en ese orden de magnitud.

Tener tantos parámetros le da una capacidad teórica inmensa para capturar matices y relaciones complejas, ya sea en un soneto, en un balance financiero o en el código fuente de un sistema operativo.

Una capacidad de aprendizaje descomunal.

Y junto a esa cifra mencionan otra que es igual de impactante.

Una ventana de contexto de hasta 128.000 tokens.

Y esto es clave para la usabilidad del modelo.

¿Qué es la ventana de contexto?

La ventana de contexto es, en esencia, la memoria a corto plazo del modelo durante una tarea.

¿Su memoria de trabajo?

Exacto. 128.000 tokens es una barbaridad.

Un token es más o menos tres cuartas partes de una palabra.

Esto significa que el modelo puede procesar y recordar el equivalente a un libro de unas 250 o 300 páginas en una sola interacción.

Un libro entero.

Pero, ¿tiene esto un coste oculto?

¿Se vuelve más lento o más caro de usar?

¿Con una memoria tan grande?

¿O incluso hay riesgo de que se confunda con tanta información?

Esa es la pregunta del millón.

Y la respuesta es sí a todo.

En cierto modo, hay un trade-off.

Claro, siempre lo hay.

Una ventana de contexto más grande consume más recursos computacionales.

Lo que se traduce en que cada interacción puede ser más lenta y más cara.

Lógico.

Y sí, existe el riesgo de lo que se llama perderse en el medio.

Cuando el contexto es tan largo, a veces los modelos tienden a prestar más atención a la información del modelo.

A veces los modelos tienden a prestar más atención a la información del modelo.

A veces los modelos tienden a prestar más atención a la información del principio y del final,

olvidando detalles cruciales que están en el centro.

¡Ah, mira!

Sin embargo, el paper sugiere que han trabajado mucho en mitigar estos problemas.

Y las ventajas son enormes.

Poder analizar un contrato legal de 200 páginas,

leer la documentación completa de una API para programar sobre ella.

O mantener una conversación muy larga sin que se le olviden las cosas.

Justo.

Abre la puerta a tareas que antes eran impensables.

Vale, el modelo es enorme, tiene una memoria prodigiosa,

pero con sus costumbres.

Ahora, la gran pregunta.

¿Cómo rinde?

El paper hace una afirmación muy directa.

Cito.

Llama 3 ofrece una calidad comparable a la de los principales modelos de lenguaje,

como GPT-4, en una gran cantidad de tareas.

Esta es una declaración muy fuerte.

Es una declaración de intenciones potentísima.

Es plantar una bandera en la cima de la montaña.

Pero esa es una afirmación que hacen ellos en su propio paper.

¿Tenemos benchmarks independientes que lo confirmen?

Porque en este campo, todos tienden a decir que su modelo es el mejor

en las métricas que ellos mismos eligen para publicar.

Tienes toda la razón en ser escéptica.

Es la actitud correcta.

Es cierto que cada laboratorio tiende a publicar los benchmarks

donde su modelo brilla más.

Claro.

Sin embargo, la afirmación es significativa por dos motivos.

Primero, porque se atreven a hacer la comparación directa

con el que ha sido el rey indiscutible, GPT-4.

Y segundo, y esto es lo más importante,

el modelo están invitando al mundo entero a que verifique esa afirmación.

Ah, es verdad.

Ya no es una caja negra.

Cualquiera puede descargarlo y ponerlo a prueba en sus propias tareas,

en benchmarks públicos como el LMS Chatbot Arena,

donde usuarios reales votan a ciegas por la mejor respuesta.

La verdadera prueba de fuego empieza ahora, en manos de la comunidad.

Y eso nos lleva al verdadero meollo del asunto.

Afirman que compiten con GPT-4, que es un sistema cerrado.

Pero supuestamente,

su gran movimiento es justamente el contrario, la liberación pública.

Exacto.

¿Qué sentido tiene hacer esa comparación

si luego no vas a competir en el mismo terreno?

¿Cuál es el movimiento estratégico aquí?

Es que la estrategia no es competir en el mismo terreno,

sino cambiar las reglas del juego por completo.

A ver.

La decisión de liberar un modelo de 405B parámetros

con un rendimiento que aspira a ser da élite,

es un terremoto para el ecosistema.

Es la jugada más audaz que hemos visto en el debate de

código abierto contra código cerrado.

¿Por qué?

¿Qué cambia realmente para la industria?

Cambia el equilibrio de poder.

Si conectamos esto con el panorama general,

estamos viendo nacer la gran batalla de las plataformas de IA.

¿Vale?

Por un lado, tienes el modelo iOS de Apple,

que es el de Open Open AI con GPT-4.

Un jardín vallado, un ecosistema cerrado,

muy pulido, muy controlado,

donde accedes a través de su API.

Sí.

Por otro lado, tienes el modelo Android,

una plataforma abierta.

Eso es lo que Meta está intentando construir con Llama.

Al liberar un modelo tan potente,

están democratizando el acceso a la IA de vanguardia.

Pero, democratizar es una palabra que se usa mucho.

¿Qué significa en la práctica?

¿Y qué gana Meta con ello, si lo está regalando?

En la práctica, significa que una startup en Valencia,

un grupo de investigación en una universidad de Buenos Aires,

o un desarrollador independiente en su casa, pueden,

si tienen los recursos de computación,

descargar este motor de última generación,

estudiarlo, adaptarlo.

¿Y construir sobre él?

Exacto. Y construir sobre él.

Esto fomenta una ola de innovación

fuera del control de los gigantes tecnológicos.

Ya.

Y lo que Meta gana es estratégico.

Su negocio principal no es vender acceso a la IA,

es la publicidad.

Están aplicando una táctica clásica,

comoditizar el complemento.

Explica eso.

Si haces que los modelos de IA de alta gama,

con una comodity gratuita, debilitas a tus rivales,

cuyo principal negocio es vender acceso a esos modelos,

y fomentas que todo un ecosistema construya sobre tu tecnología,

lo que a la larga te beneficia.

Actura por defecto de la nueva era de la IA.

Justo. Una jugada maestra.

Una jugada maestra a nivel estratégico, entonces.

Y junto con este motor potentísimo,

el paper dice que también liberan algo llamado LamaWard 3

para la seguridad de entradas y salidas.

Sí.

Parece una especie de guardaespaldas digital.

Es una descripción móvil.

Es una descripción muy acertada.

LamaWard 3 es, casi con total seguridad,

un modelo más pequeño y especializado,

entrenado para una única misión,

la moderación de contenido.

Vale.

Analiza las peticiones que recibe el modelo principal

y las respuestas que genera,

para filtrar y prevenir contenido dañino, sesgado o inapropiado.

Y el hecho de que lo liberen junto al modelo principal.

Es un claro ejercicio de responsabilidad.

Te están dando la herramienta de poder y la de seguridad.

Pero, ¿este guardia es de uso obligatorio

o es opcional?

¿Qué pasa si alguien descarga el modelo

y decide simplemente no usarlo?

Es totalmente opcional.

Y ahí está el quid de la cuestión del código abierto.

Meta te da las herramientas para un uso seguro,

pero no puede obligarte a usarlas.

Claro.

Es como si al venderte un coche de Fórmula 1

te dieran también los mejores frenos y sistemas de control.

Te están diciendo,

aquí tienes algo increíblemente potente

y aquí tienes cómo usarlo de forma segura.

Pero en última instancia,

el conductor tiene el control.

Exacto.

Esta libertad es lo que hace tan potente al código abierto,

pero también lo que abre el debate sobre la responsabilidad final.

Un debate que seguro que seguirá.

Pero la ambición no se detiene en el texto.

El paper dedica una sección a mirar hacia el futuro,

y ese futuro es multimodal.

Sí.

Hablan de integrar capacidades de imagen,

vídeo y voz.

Sí, y es un vistazo muy revelador.

Mencionan que lo están haciendo a través de un

enfoque composicional.

¿Y eso qué significa?

Pues sugiere que en lugar de construir

un único modelo monolítico gigantesco que lo haga todo,

lo cual sería extremadamente complejo y caro,

probablemente estén conectando el poder de Llama 3,

como cerebro lingüístico,

con otros modelos especializados en visión o audio.

Ah, como si le conectaran diferentes sentidos al cerebro principal.

Es un enfoque mucho más modular, sí.

Y dicen que los resultados son competitivos,

pero apuntan un detalle crucial.

Estos modelos multimodales aún no se están liberando de forma generalizada

porque todavía están en desarrollo.

Y esa es una decisión muy prudente y significativa.

Esto plantea una pregunta importante.

¿Por qué ser tan audaces liberando el modelo de texto más grande,

pero tan cautos con los multimodales?

Entonces, ¿están admitiendo implícitamente que no tienen todavía un

Llama Word para imágenes y vídeo que sea lo bastante bueno

como para soltarlo al público?

Exactamente. Has dado en el clavo.

La multimodalidad añade capas de riesgo exponencialmente mayores.

Claro, no es lo mismo.

Ya no hablamos sólo de texto inapropiado.

Hablamos de la generación de deepfakes de vídeo y audio,

de desinformación visual a gran escala.

Moderar imágenes, vídeos y voces es un desafío técnico y ético

mucho más complejo que moderar texto.

Muchísimo más.

Su cautela aquí sugiere que están tomándose muy en serio esos riesgos,

y que prefieren esperar a tener soluciones de seguridad más robustas.

Tiene todo el sentido.

Entonces, ¿qué significa todo esto?

Si tuviéramos que resumir el impacto de este paper en tres ideas clave,

¿cuáles serían?

Yo diría que la primera es que Llama 3 no es un modelo.

Es una manada.

Una plataforma completa de herramientas fundacionales potentísimas.

Vale. Primera idea.

La segunda, que es un modelo estrella de 405 B parámetros,

no sólo es enorme,

sino que se postula para competir de tú a tú en la primera división

con los mejores modelos cerrados del mundo.

Y la tercera, y la más importante,

es que este poder no se queda encerrado en un laboratorio.

Está disponible para todos,

lo que supone un catalizador masivo para la innovación en el campo del código abierto.

Y además, ya nos dan una pista de lo que viene después.

Un futuro donde la IA no sólo leerá y escribirá,

sino que también verá, oirá y hablará.

Exacto.

En perspectiva global, este paper es un hito

para el movimiento de la inteligencia artificial de código abierto.

Sin duda.

Durante años ha existido el temor de que la IA más avanzada

quedara exclusivamente en manos de unas pocas corporaciones.

La liberación de Llama 3 es el contrapeso más fuerte y real

que hemos visto hasta ahora a esa tendencia.

Es un cambio de paradigma.

Potencialmente.

Puede acelerar la innovación a nivel mundial

al poner herramientas de élite en manos de una comunidad global de desarrolladores.

Es un antes y un después.

Me quedo pensando en algo.

El paper insiste mucho en la responsabilidad,

en dar herramientas como Llama Guard.

Pero al abrir la caja de Pandora

y entregar un motor tan potente a todo el mundo,

la responsabilidad se difumina.

Ya no estás sólo en el creador,

sino en miles de manos anónimas que pueden modificarlo.

La pregunta que queda en el aire es si,

como comunidad global, estamos preparados para manejar este poder.

Es la pregunta fundamental.

¿Superan los innegables beneficios del acceso abierto

a los riesgos potenciales que también se abren de par en par?

Es la pregunta fundamental de nuestra era

y no tiene una respuesta fácil, la verdad.

Mañana continuaremos nuestro viaje por la historia de la IA

con otro paper que, les aseguro, es fascinante

y cambió las reglas del juego en su momento.

No se lo pierdan.

Y hasta aquí el episodio de hoy.

Muchas gracias por tu atención.

Esto es BIMPRAXIS.

Nos escuchamos en el próximo episodio.